人工智能(AI)技术突飞猛进,正以前所未有的深度和广度重塑社会生产与生活方式。作为AI技术落地的核心载体,基础软件的开发与创新直接决定了AI能力的上限与应用效率。在行业一片繁荣的表象之下,人工智能基础软件的开发正面临着一系列深刻而紧迫的挑战,尤其以下三大问题尤为突出,制约着整个生态的健康与可持续发展。

一、技术复杂性剧增与工程化落地之困

人工智能,特别是深度学习模型的复杂性与日俱增,从模型的训练、优化、部署到持续的监控与迭代,构成了一个极其复杂的技术栈。这给基础软件的开发带来了前所未有的工程挑战。

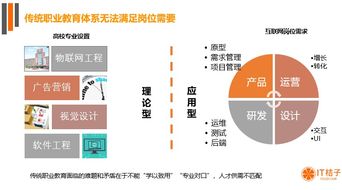

开发门槛高企。传统的软件开发范式已难以应对AI特有的不确定性。开发者不仅要精通算法,还需深刻理解分布式计算、异构硬件加速、大规模数据处理等底层技术。将前沿算法转化为稳定、高效、可大规模部署的软件产品,需要跨越从理论到实践的“最后一公里”,这往往比算法创新本身更为艰巨。

全生命周期管理缺失。目前,市场上存在大量专注于模型训练或推理的单一工具,但缺乏能够无缝覆盖数据准备、模型构建、训练、部署、监控、版本管理和再训练的一体化、标准化平台。这种碎片化状态导致AI项目开发周期长、协作困难、维护成本高昂,严重阻碍了AI技术在传统行业的快速渗透和规模化应用。

二、生态碎片化与标准化进程滞后

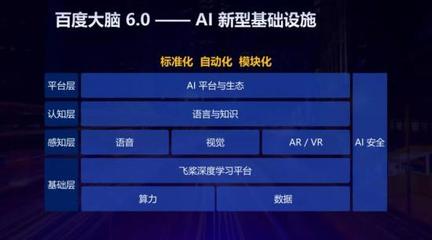

人工智能技术路线多样,硬件架构(如CPU、GPU、NPU等)与软件框架(如TensorFlow、PyTorch、MindSpore等)呈现“百花齐放”的局面。这种繁荣在促进创新的也导致了严重的生态碎片化问题。

框架与硬件的绑定与割裂是核心痛点。不同AI框架对底层硬件的支持程度不一,优化策略各异,使得开发者为适配不同硬件平台需要付出巨大的移植和调优成本。各家厂商出于商业利益构建技术壁垒,进一步加剧了互操作性的困难。用户被锁定在特定的技术栈中,选择灵活性和未来迁移成本成为重大担忧。

尽管行业已意识到标准化的必要性,并出现了如ONNX(开放式神经网络交换格式)等跨框架模型标准,但统一、权威的软硬件接口标准、性能评测基准和安全性规范仍然缺位。标准化的滞后,使得跨平台、跨框架的模型迁移、部署和性能对比变得异常复杂,不仅增加了开发者的负担,也拖慢了整个产业协同创新的步伐。

三、安全、可信与伦理要求带来的全新维度挑战

随着AI深入金融、医疗、自动驾驶等关键领域,其基础软件的安全性与可信赖性已成为不可回避的刚性要求。这为软件开发引入了传统领域未曾有过的全新维度挑战。

安全性层面,AI模型本身及其依赖的庞大训练数据、复杂的计算图都可能成为攻击目标。对抗性攻击、数据投毒、模型窃取等新型威胁层出不穷,要求基础软件必须内置强大的安全防护机制,从数据加密、访问控制到运行时防护,构建纵深防御体系。

可信与可解释性层面,许多先进的深度学习模型如同“黑箱”,其决策过程难以理解。在要求高可靠性和问责制的场景下,这种不可解释性构成了重大障碍。因此,基础软件需要集成模型可解释性(XAI)工具,提供决策依据追溯、公平性检测、偏差分析等功能,帮助开发者构建和审计可信的AI系统。

伦理与合规层面,全球范围内数据隐私保护法规(如GDPR)日益严格,AI伦理准则陆续出台。基础软件开发必须将隐私计算(如联邦学习、安全多方计算)、算法公平性审计、数据生命周期合规管理等功能作为基础能力进行设计和实现,否则其产品将面临巨大的法律与市场风险。

###

人工智能基础软件的开发已步入“深水区”,其面临的挑战从单纯的技术性能比拼,扩展到了工程体系、生态协同、安全可信等多维度的综合竞争。破解这三大问题,需要产、学、研、用各方协同努力:在技术上,推动软硬件协同设计,开发更高效、更易用的全生命周期管理平台;在生态上,积极拥抱开放,推动关键接口与标准的制定与落地;在理念上,将安全、可信、合规内化为软件开发的核心基因。唯有如此,才能夯实人工智能发展的基石,释放其赋能千行百业的巨大潜能,推动智能时代行稳致远。